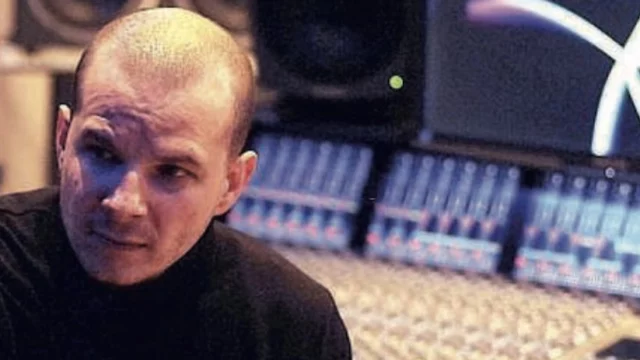

Philip Abussi: musica e intelligenza artificiale, la rivoluzione è pronta

L’IA non ci deve spaventare, perché consentirà ai compositori di creare nuovi generi musicali e nuovi suoni

Talento e innovazione. Queste le caratteristiche di Philip Abussi, giovane compositore che guarda all’Intelligenza artificiale per dare al suo modo di fare musica un tocco di originalità e unicità: “Anche grazie alla collaborazione con Anita Falcetta e Mokamusic”, spiega, “sto effettuando delle vere sperimentazioni con l’obiettivo di realizzare qualcosa di diverso che possa farsi notare in quell’oceano musicale basato su modelli abbondantemente utilizzati. L’AI serve a questo, se usata dall’artista come uno strumento, al pari di un pianoforte, di una chitarra o di un sintetizzatore che, se ci pensiamo, sono anch’essi estensioni tecnologiche dell’uomo”.

Impegnato in diversi progetti che guardano alla modernità, Abussi è noto per la sua capacità di adattare le proprie conoscenze musicali ai tempi del 4.0: “Ho partecipato a un progetto artistico con Mauro Martino al Meet Digital Culture Center e ho preso parte alla Rome Future Week con l’opera audiovisiva Roma Pons Mundi. Sono da sempre impegnato a scoprire nuovi orizzonti e a puntare su nuovi mondi creativi musicali.

Sono certo che l’AI stimolerà una nuova era di autenticità e sperimentazione. Gli artisti la utilizzeranno come uno strumento per amplificare la loro visione creativa. Vedremo emergere generi musicali nuovi, nati dalla simbiosi tra sensibilità umana e le potenzialità delle nuove e sempre più raffinate tecnologie”.

Una sfida quella di Abussi, cresciuto dal punto di vista musicale con i consigli di Riz Ortolani, che si gioca su vari livelli e può avere anche una funzione altamente sociale: “Sono sicuro che l’Intelligenza artificiale rivoluzionerà, ad esempio, anche la musicoterapia. Algoritmi avanzati analizzeranno i nostri parametri biometrici e psicologici in tempo reale, generando composizioni terapeutiche su misura.

Ma la partita della modernità potrebbe mandare in soffitta il concetto tradizionale di copyright. Prevedo infatti l’emergere di smart contracts basati su blockchain che gestiranno automaticamente i diritti e le royalties. Questo sistema permetterà una migliore distribuzione dei proventi e incoraggerà la collaborazione creativa tra umani e AI”.

“Alcuni dei miei strumenti preferiti sono Synth gpt, il primo text-to-synth che permette all’artista o produttore musicale di creare il proprio suono e di suonarlo con una tastiera esattamente come un synth; TextToSample per generare parti ritmiche e Audiogen per le parti ritmiche e per il sound design; Eleven Labs per il text-to-speech (il parlato generativo) e molti altri strumenti dedicati alla post audio per ottimizzare in modo piuttosto efficiente i tempi di mix e mastering”.

Ma la visione di Abussi guarda oltre: “L’AI permetterà di creare esperienze live su scala globale mai viste prima. Come, ad esempio, un concerto simultaneo in 50 città diverse, dove l’artista si esibisce fisicamente in una location, mentre ologrammi ultra-realistici, potenziati dall’Intelligenza artificiale, replicano la performance nelle altre 49.

Ma c’è di più: l’AI sincronizzerà in tempo reale le reazioni del pubblico in tutti i luoghi, creando un’energia collettiva che trascende i confini geografici. Gli spettatori potranno interagire non solo con l’artista, ma anche tra loro, indipendentemente da dove si trovino nel mondo”.

Un’opportunità dunque che non deve spaventare: “Sono sempre più convinto – conclude Abussi – che l’Intelligenza artificiale possa aiutare l’industria. Inoltre, ci sarà sempre bisogno di consulenza in campo musicale (e non solo), e questo ad oggi richiede ancora una sensibilità e un’esperienza prettamente umane“.